大模型背后的意图,探索精简表达与行动导向的力量

本文旨在探索大模型、精简表达与行动导向背后的意图,通过对大模型的研究,挖掘其潜在的应用价值和意义;强调精简表达的重要性,追求更高效、准确的沟通方式;关注行动导向的实践性,将理论与实践相结合,以实现具体目标和解决实际问题,本文旨在探讨这些要素的内在联系和实际应用,以推动相关领域的发展。

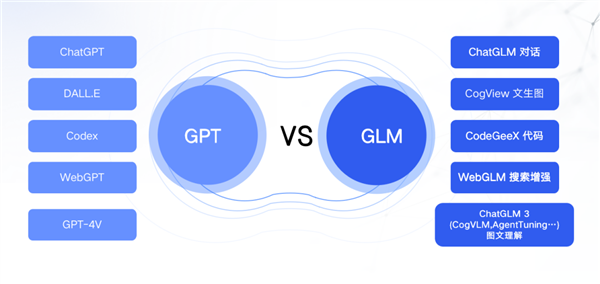

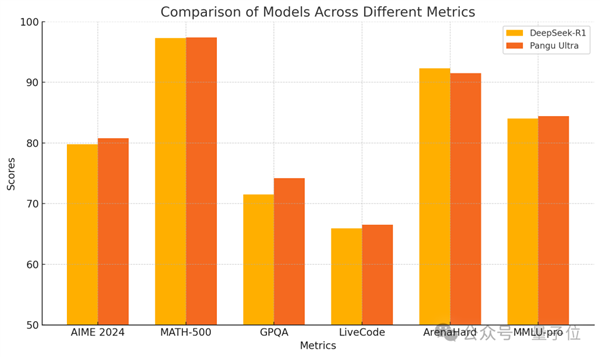

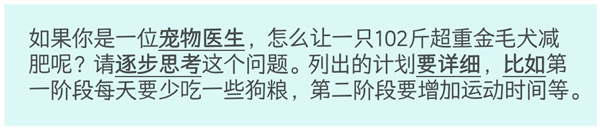

关于大模型的讨论日渐热烈,其核心在于其表达方式的简洁性和明确性,许多用户反馈,大模型在运行时会产生冗长的描述或提示,使得其目的和任务不够明确,这引发了关于如何更简洁地表达以提高沟通效率和用户体验的讨论。 你是否曾经使用过AI工具,并尝试通过提示词来引导其完成某些任务?你对写提示词的技巧可能已有一定的掌握,例如逐步拆解思维链,给予模型一些例题帮助理解,或者引导模型进行角色扮演以获取更专业的答案,随着大模型技术的不断进步,一个全新的时代已经来临。 以GPT-o1为例,它不再仅仅是GPT-4o的直属版本升级,而是步入了推理模型的时代,类似的,DeepSeek也有其默认的V3通用大模型和点击深度思考按钮后启动的R1推理模型,在推理模型时代,过于详细的提示词可能会适得其反,让AI变得更加笨拙,OpenAI的官方文档指出,使用过于精确的提示词或引导思考的写法可能会降低回答效果,建议我们尽量减少使用思维链提问,直接描述问题即可。 DeepSeek-R1的官方技术报告也提到了这一点,他们对提示词很敏感,举例提示反而会降低模型表现,除了GPT和DeepSeek,其他的模型如Claude 3.7 Sonnet也在官方文档中表示,相比那些看似有逻辑、每一步都详细列出具体做法的提示词,他们更希望你直接指示他们做什么。 为什么会发生这种变化呢?这主要是因为传统非推理模型和推理模型的思考方式发生了转变,源于其训练方式的不同,传统的大模型一般采用无监督学习和监督微调,而推理大模型则加入了强化学习等基于推理的训练方法,这种训练过程使得大模型能够自主判断某些想法是否正确,从而更加独立地解决问题。 在我们的实验中,我们发现使用传统的提示词方式在某些问题上会让推理模型o1表现不佳,但当我们简化提示词,直接描述问题时,o1却能够给出正确的答案,随着大模型能力的不断进化,写提示词的方式也需要改变,我们需要更新提示词库,以适应新的模型需求,尊重AI的操作、清晰简洁地表达需求,可能是当下最有效的与AI合作的方式。 这是否意味着提示词工程这一手艺会完全消失呢?曾写出“汉语新解”等神级提示词的大神李继刚老师表示,只要不同的输入还能带来不同的输出,提示词工程就有存在的价值,随着技术的进步和模型能力的发展,我们需要与时俱进地调整与AI交互的方式,这样才能更好地利用AI工具,提高我们的工作效率。